La inteligencia artificial y la erosión del pensamiento

Nunca fue tan fácil construir.

Nunca fue tan difícil entender qué estamos construyendo.

Hoy es normal abrir una herramienta de IA, pedir una solución, ajustarla mínimamente y seguir.

Funciona. Compila. Resuelve.

Pero muchas veces no entendemos realmente por qué.

Y eso, aunque parezca menor, marca un cambio profundo.

Esto no es una crítica a la inteligencia artificial.

Es una crítica a como elegimos usarla.

I. La trampa de la eficiencia

La narrativa general es simple:

si una tarea que tomaba horas ahora toma minutos, ganamos.

A nivel individual, es cierto.

A nivel colectivo, es más complejo y descontructivo.

Cada vez que aceptamos código sin cuestionarlo, cada vez que priorizamos velocidad sobre comprensión, empujamos el valor de esa habilidad hacia un terreno más difuso. No porque la IA sea superior, sino porque dejamos de diferenciarnos en ese plano.

La eficiencia, llevada al extremo, deja de ser ventaja.

Se convierte en estandarización del minimo esfuerzo.

II. El espejismo del control

Seguimos diciendo que usamos herramientas para mejorar.

Pero no es así.

Ya no delegamos solo ejecución.

Delegamos partes del proceso mental:

-

exploración

-

decisiones intermedias

-

memoria

La IA no está reemplazando tareas.

Está ocupando espacio dentro del pensamiento.

Y lo hace sin fricción, porque el resultado inmediato es suficiente.

Tal vez esto no sea un problema. Tal vez sea simplemente evolución.

Pero hay algo en este cambio que merece, al menos, ser observado con más atención.

III. Cuando todo funciona, nada destaca

A medida que producir software se vuelve más accesible, ocurre algo menos visible:

El estándar mínimo sube.

Pero la percepción de valor baja.

El mercado se llena.

Las diferencias se vuelven sutiles.

La mayoría de las soluciones son “lo suficientemente buenas”.

Y en ese contexto, el foco se desplaza:

ya no importa tanto quién sabe construir,

sino quién logra destacar en medio del ruido.

IV. El desplazamiento silencioso

El valor no desaparece. Se mueve.

Ya no está en escribir código.

Ni siquiera en resolver problemas técnicos aislados. Empieza a concentrarse en algo menos evidente y

más exigente:

-

formular mejores preguntas

-

detectar errores plausibles

-

sostener criterio cuando todo responde rápido

En una palabra:

discernir.

Y eso no escala igual.

No es inmediato.

No tiene recompensa instantánea. Por eso es tan fácil dejarlo de lado.

V. Otra forma de usar la IA

El problema no es usar inteligencia artificial.

Es usarla como sustituto en lugar de como estructura. Existe otra forma, menos evidente:

-

no llamar a la IA si el problema ya está resuelto

-

no delegar decisiones que definen el resultado

-

no optimizar por velocidad cuando se pierde comprensión

-

no tratar a la IA como autor, sino como sistema de validación

En este enfoque, la IA no produce conocimiento.

Lo organiza, lo filtra, lo tensiona.

No acelera el pensamiento.

Lo vuelve más preciso. Se convierte asi, en un curador de tu concocimiento, para mejorar y crecer en

tu ambito social.

VI. Probarlo en la práctica

Esta incomodidad no se resuelve con opinión. Necesita ser puesta a prueba.

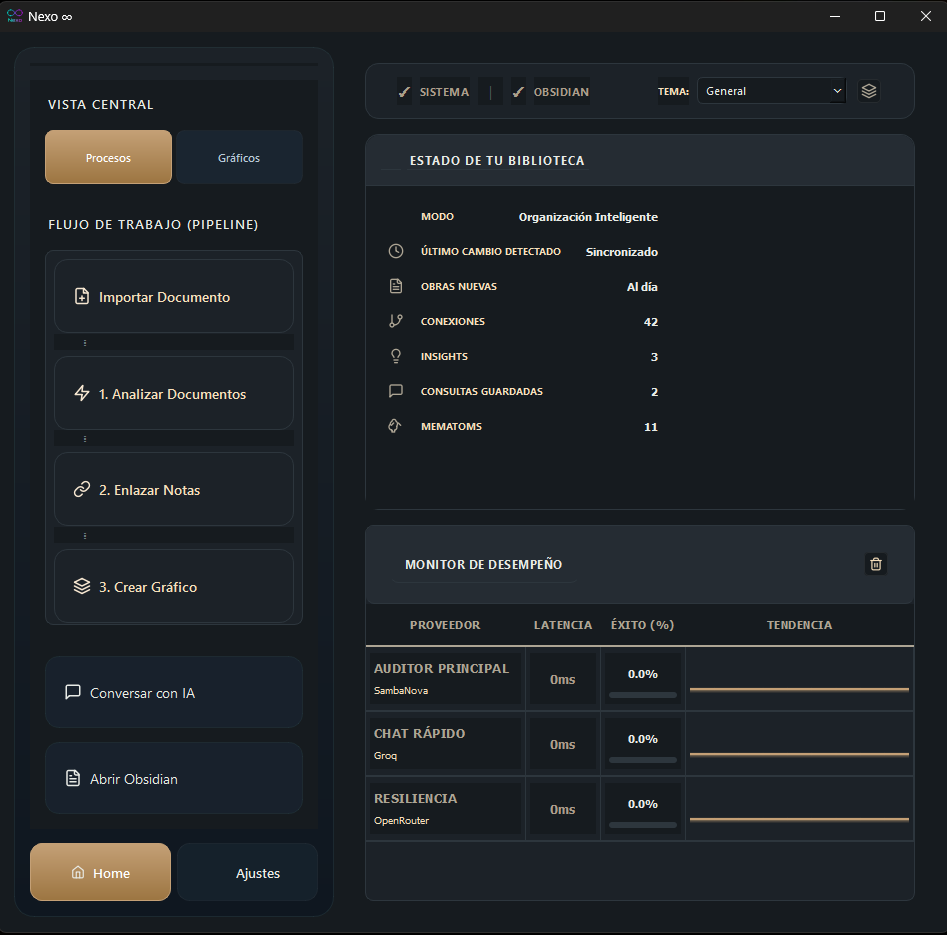

Con esa idea en mente, desarrollé un sistema como experimento. No como producto terminado aunque si lo es, ni como respuesta definitiva, sino como una forma de explorar este enfoque en la práctica.

La premisa es simple, pero exigente:

evitar usar inteligencia artificial cuando no es necesaria.

A partir de ahí, todo cambia.

El sistema prioriza:

-

reutilizar conocimiento antes de generar nuevo

-

estructurar la memoria en lugar de acumular respuestas

-

separar funciones en lugar de centralizar en una sola IA

-

mantener a la persona en el circuito de decisión

No busca hacer más rápido el proceso.

Busca que el proceso siga existiendo.

Si te interesa explorarlo desde lo técnico, dejé el proyecto abierto:

https://github.com/Ccom5/Nexo-

VII. La ilusión de comprender

Durante mucho tiempo dijimos que las matemáticas describen el orden del universo.

Pero también se puede mirar al revés:

las matemáticas son la herramienta que construimos para volver comprensible aquello que no entendemos.

No son el fenómeno.

Son el lenguaje que usamos para acercarnos a él.

Y con la inteligencia artificial pasa algo similar.

Los modelos, los algoritmos, los agentes:

no son comprensión en sí mismos.

Son estructuras matemáticas que producen resultados coherentes.

Hay una vieja sentencia:

"toda tecnología suficientemente compleja es indistinguible de la magia." La famosa tercera ley

formulada por el escritor de ciencia ficción Arthur C. Clarke en 1962, la cual sugiere que cuando

una tecnología supera nuestra comprensión, la percibimos como un fenómeno mágico o sobrenatural

El problema no es que parezca magia.

El problema es empezar a tratarla como si lo fuera.

Cuando el resultado es suficientemente bueno, dejamos de preguntarnos cómo funciona.

Confundimos capacidad de producir respuestas

con capacidad de entender.

VIII. Lo que realmente está en juego

La inteligencia artificial no está eliminando el valor del programador. Está eliminando la parte del valor que era superficial. Y eso deja una pregunta incómoda:

¿cuánto de lo que hacíamos era realmente pensamiento,

y cuánto era ejecución bien entrenada?

Hoy, gran parte de esa ejecución es automatizable. Lo que no lo es —todavía—

es sostener criterio cuando ya no es estrictamente necesario hacerlo.

El problema no es que ahora cualquiera pueda construir. El problema es que cada vez menos personas necesitan entender lo que construyen.

Tal vez el mayor riesgo no es que la inteligencia artificial piense por nosotros. Es que, cuando

deje de hacerlo, o no logre hacerlo,

ya no sepamos cómo volver a pensar.